지난 몇 년 동안 CES의 프레스 컨퍼런스나 키노트에서 엔비디아는 줄곧 인공 지능과 자율 주행 자동차에 대한 AI 기술과 GPU 제품을 공개했다. 하지만 이번 CES 2019에서 엔비디아의 CEO 젠슨 황은 그 이전 CES에서 말했던 모든 주제를 접은 채 오로지 게이밍만 말하겠다고 선언한 뒤 1시간 30분 동안 발표를 이어갔다. 그 모든 이야기의 중심에 지포스 RTX 2060이 있었고, G싱크 얼티밋과 지포스 RTX 20을 탑재한 게이밍 노트북이 뒤따랐다.

지난 몇 년 동안 CES의 프레스 컨퍼런스나 키노트에서 엔비디아는 줄곧 인공 지능과 자율 주행 자동차에 대한 AI 기술과 GPU 제품을 공개했다. 하지만 이번 CES 2019에서 엔비디아의 CEO 젠슨 황은 그 이전 CES에서 말했던 모든 주제를 접은 채 오로지 게이밍만 말하겠다고 선언한 뒤 1시간 30분 동안 발표를 이어갔다. 그 모든 이야기의 중심에 지포스 RTX 2060이 있었고, G싱크 얼티밋과 지포스 RTX 20을 탑재한 게이밍 노트북이 뒤따랐다.

지포스 RTX 2060은 엔비디아가 지난 해 8월 말 새로운 튜링 아키텍처 기반의 그래픽 카드 시리즈로 내놓았던 지포스 RTX 2080ti와 2080, 2070에 이어 보급형 제품군의 자리를 채울 제품이다. 앞서 발표했던 하이엔드 RTX 20 제품들과 설계는 비슷하나 더 낮은 가격대의 제품인 만큼 성능이나 일부 제원은 이에 맞춰 변경했다.

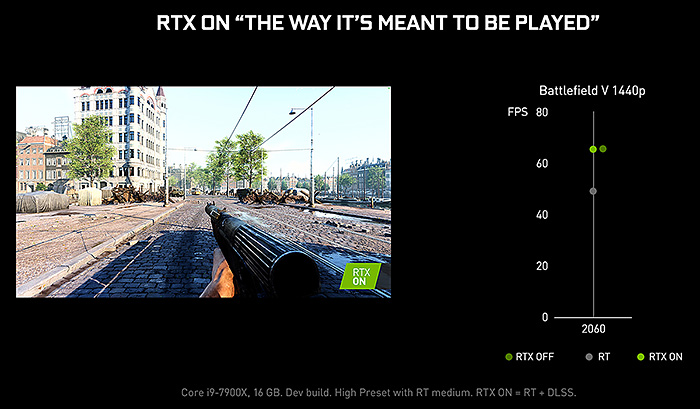

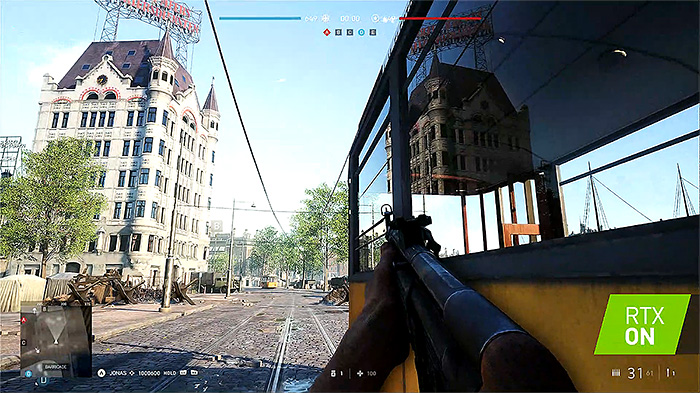

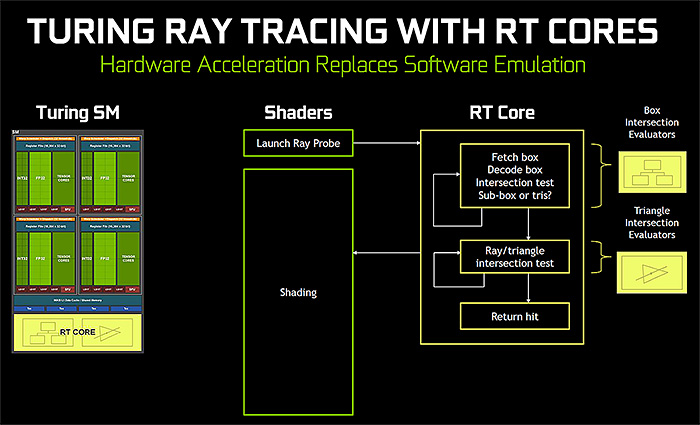

그런데 이 발표를 지켜 본 이들이라면 RTX 2060의 성능을 발표할 때 이상한 점을 느꼈을 것이다. 엔비디아는 1440p 해상도로 실행한 배틀 필드 V의 광선 추적 기능을 껐을 때 60프레임을 넘기지만, 광선 추적 렌더링을 활성화하면 40~50프레임으로 떨어진다고 설명했다. 광선 추적(Ray Tracing)을 처리하기 위한 RT 코어를 내장했어도 실시간으로 이를 처리하는데 그만큼 부담이 늘어나 프레임이 떨어지는 것은 불가피한 일이다. 때문에 여기까지 이상한 점을 발견하긴 힘들 것이다. 그러나 광선 추적을 활성화한 뒤에도 껐을 때만큼 프레임을 회복한 결과를 공개했을 때 이것을 RTX 2060의 성능으로 봐야 할지 의구심을 갖게 된다. 물론 이것은 RTX 2060 뿐만 아니라 RTX 2070과 2080 등 다른 RTX 20 그래픽 카드에서도 같은 결과로 나타날 수 있다.

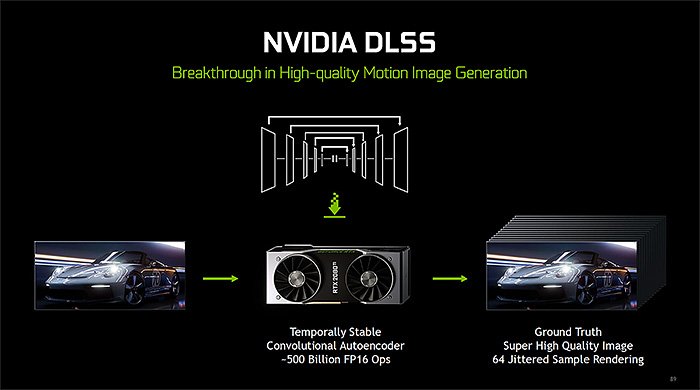

물론 마지막 광선 추적을 활성화한 결과를 껐을 때의 수준으로 올린 데는 딥 러닝 슈퍼 샘플링(Deep Learning Super Sampling, 이하 DLSS)이라는 비결이 있기는 하다. DLSS는 원래의 이미지보다 더 높은 해상도로 렌더링된 이미지의 정보를 활용해 선명한 이미지로 만드는 슈퍼 샘플링을 기계 학습으로 훈련 시키는 기법이다. 즉, 기계 학습으로 GPU에서 처리한 렌더링 그래픽과 유사한 결과를 낼 수 있도록 훈련한 뒤 이를 게임에 적용하면 GPU는 이전보다 적은 작업으로 거의 비슷하거나 오히려 더 선명한 그래픽 렌더링을 내놓게 된다. DLSS를 거치면 GPU가 그래픽의 모든 부분을 세세하게 그려낼 필요 없이 부족한 부분의 결과는 인공 지능의 추론을 통해 채워지게 된다. 튜링 아키텍처에 추가된 텐서 코어가 채워야 할 정보를 추론하는 일을 맡는다.

그런데 DLSS는 한 가지 문제를 안고 있다. 모든 게임에서 DLSS를 활성화할 수 있는 게 아니라는 점이다. 말 그대로 기계 학습으로 슈퍼 샘플링 과정을 충분히 거치지 않은 게임에서는 DLSS가 작동하지 않는다. 물론 DLSS를 지원하지 않아도 광선 추적을 지원하는 게임을 실행할 수는 있지만, 모든 처리를 GPU가 떠맡는 만큼 늘어나는 부담으로 인해 프레임 저하는 감수해야만 한다.

그렇다면 광선 추적을 지원하는 모든 게임에서 DLSS를 활용하면 될 일이다. 광선 추적+DLSS가 엔비디아 지포스 RTX의 가장 핵심적인 이유이기 때문이다. DLSS가 꼭 광선 추적 처리를 위한 기술은 아니지만, 만약 이전 세대 그래픽 카드와 비슷한 그래픽 품질, 더 나은 프레임을 위한 것이라면 튜링 아키텍처의 RT 코어는 존재할 가치를 찾기 어려워진다. 결과적으로 RT+DLSS는 품질과 성능을 보완하는 불가분의 가치가 있고, 이 두 가지를 모두 해낼 수 있을 때 지포스 RTX가 필요하다고 말할 수 있다.

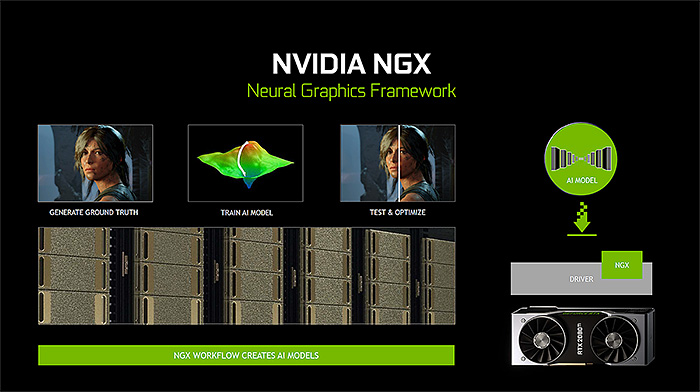

그러면 엔비디아는 어떻게 기계 학습의 결과를 그래픽 카드에 반영할까? DLSS를 위한 훈련을 하려면 그래픽 카드에서 신경망의 결과를 비교할 수 있는 최상급 품질의 원본이 되는 ‘그라운드 트루스’ 이미지를 만들어야 한다. 학습 및 비교를 위한 원본 이미지는 게임 엔진이 특정 장면에서 만들어낼 수 있는 각기 다른 64개 이미지를 모아서 만드는 데, 이 이미지와 유사한 이미지를 만들어낼 때까지 계속 심화 신경망에서 훈련하며 결과를 비교해 알고리즘을 완성해 간다.

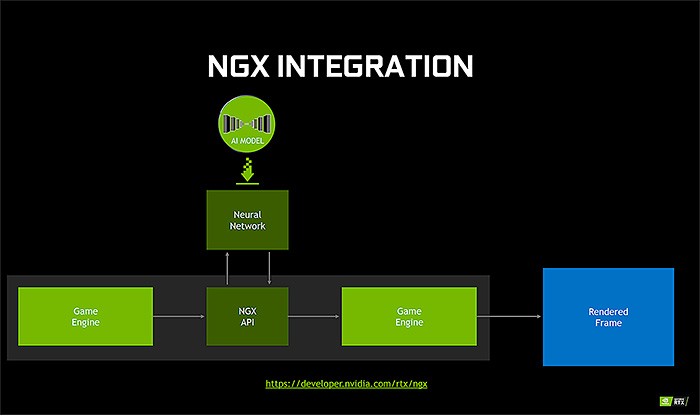

이때 기계 학습에 의한 슈퍼 샘플링 훈련은 이용자의 그래픽 카드가 아니라 기계 학습을 위해 엔비디아가 구축한 서버에서 진행된다. 때문에 엔비디아는 기계 학습을 위한 신경망 컴퓨터를 연결하는 NGX 기술을 선보였고 RTX와 함께 공개한 NGX 소프트웨어 개발 도구로 게임 엔진과 엔비디아의 신경망 서버가 연동되도록 설계했다. 게임 엔진에서 NGX API를 통해 엔비디아 신경망 컴퓨터로 학습해야 할 모델을 보내 훈련한 뒤 구축된 인공 지능 알고리즘을 게임 엔진으로 가져와 이용자의 RTX 그래픽 카드에서 활용하는 구조다.

흥미로운 점은 신경망 훈련을 계속 할수록 이용자가 보게 되는 그래픽 렌더링의 결과는 더 좋아질 수 있다는 점이다. NGX 기술은 기계 학습으로 원본에 근접한 이미지를 만들어내는 알고리즘을 찾는 것이 목표지만, 원본을 넘어서는 결과도 나올 수 있다. 훈련에 따라 알고리즘을 더 개선할 수 있으므로 DLSS를 활성화하는 것이 앤티 앨리어싱을 적용한 렌더링 그래픽보다 더 나을 수도 있다고 엔비디아는 말한다.

이처럼 기계 학습을 도입해 달라지는 그래픽 결과는 기존의 상식과 다르다. 정해진 흐름에 따라 처리하는 파이프라인 구조에서 결과는 언제나 같지만, 기계 학습에 의해 개선된 알고리즘을 개입시키는 DLSS는 시간이 흐를 수록 처음과 다른 결과를 볼 수도 있는 것이다. 언제나 같은 그래픽을 볼 수 있던 이전 세대의 그래픽 카드와 다르게 DLSS를 도입한 RTX는 시간이 지날 수록 더 나은 품질에 프레임도 올라가는 특이한 성질을 갖고 있는 것이다.

결국 DLSS로 RTX 그래픽 카드의 능력을 살리려면 게임에서 엔비디아의 서버를 이용하는 훈련 모델을 제공해야만 한다. NGX 도구로 신경망 훈련 모델을 제공하지 않는 게임은 RTX 그래픽 카드에서 힘을 잃을 수밖에 없는 것이다. 그냥 평범하다 못해 이전 그래픽 카드 대비 특징도 없으므로 그냥 비싼 그래픽 카드라는 비아냥을 받아도 할 말이 없다. 마치 슈퍼맨이 힘을 모두 잃고 평범한 사람으로 변하는 셈이다.

반대로 훈련된 인공 지능 기반 그래픽 알고리즘을 적용한 게임에서 RTX는 더 나은 그래픽 카드가 된다. 원래의 힘을 되찾을 뿐만 아니라 이전 세대에서 고성능 그래픽 카드와 견줄 만큼 힘을 내기도 한다. 엔비디아가 지포스 RTX 2060을 내놓을 때 GTX 1070Ti에 맞먹는 능력이라고 주장하는 것도 DLSS 없이 할 수 있는 말은 아니다.

엔비디아는 지난 해 국내에서 진행한 지포스 테크 브리핑에서 DLSS를 위해 자사의 슈퍼 컴퓨터에서 신경망 훈련을 하는 비용을 한 푼도 받지 않는다고 답했다. 훈련을 하기 위해 더 많은 게임 데이터를 모아야 하는 엔비디아가 게임 개발사의 협조를 구하고 있는 것이다. 아마도 시간이 지나면 광선 추적 그래픽을 게임에서 구현하려는 개발사들이 호응하면서 상황은 나아질 것이다.

그러나 지금 DLSS로 광선 추적 렌더링을 함께 활성화할 수 있는 게임이 <라이즈 오브 툼레이더>나 <배틀 필드 V>, <앤썸> 등 아직 소수에 불과하다는 것이 문제다. 엔비디아는 웹사이트에 DLSS를 지원하는 게임을 공개하고 있지만, 이 중 RT+DLSS를 모두 지원하는 게임을 구별하는 게 쉽지 않다. <저스티스>처럼 실시간 광선 추적과 DLSS를 동시에 적용한 게임이 있는 반면 <서바이벌 이볼브드>나 <PUBG> 등 DLSS만 적용된 게임도 있고 DLSS를 적용하던 <파이널 판타지 XV>는 광선 추적 렌더링에 대한 향후 계획을 취소한 상황이다.

엔비디아는 지포스 RTX를 내놓으며 실시간으로 빛에 의한 효과를 담은 그래픽의 게임을 성능 저하 없이 즐길 수 있는 점을 강조해 왔다. 하지만 광선 추적을 지원하지 않는 게임에서 이전 세대와 월등한 성능의 차이를 경험하기 어렵고, 광선 추적을 켰을 때 프레임 저하를 고민해야 하는 것이 현실이다. 엔비디아가 공들여 설명한 궁극의 기술인 DLSS 기반의 광선 추적 렌더링에 대한 눈에 띄는 결과를 경험하려면 인공 지능이 공부를 마칠 때까지 인내를 갖고 기다려야 한다. 무엇보다 제값 할 능력을 갖출 때를 예측할 수 없는 것이 가장 불안한 부분이다. 인공 지능 기반 그래픽 기술이 갖고 있는 장점은 좋지만, 그보다 앞서 현실을 살고 있는 인간 지능에 맞는 상식적인 대책도 서둘러야 하지 않을까?

엔비디아는 지포스 RTX를 내놓으며 실시간으로 빛에 의한 효과를 담은 그래픽의 게임을 성능 저하 없이 즐길 수 있는 점을 강조해 왔다. 하지만 광선 추적을 지원하지 않는 게임에서 이전 세대와 월등한 성능의 차이를 경험하기 어렵고, 광선 추적을 켰을 때 프레임 저하를 고민해야 하는 것이 현실이다. 엔비디아가 공들여 설명한 궁극의 기술인 DLSS 기반의 광선 추적 렌더링에 대한 눈에 띄는 결과를 경험하려면 인공 지능이 공부를 마칠 때까지 인내를 갖고 기다려야 한다. 무엇보다 제값 할 능력을 갖출 때를 예측할 수 없는 것이 가장 불안한 부분이다. 인공 지능 기반 그래픽 기술이 갖고 있는 장점은 좋지만, 그보다 앞서 현실을 살고 있는 인간 지능에 맞는 상식적인 대책도 서둘러야 하지 않을까?