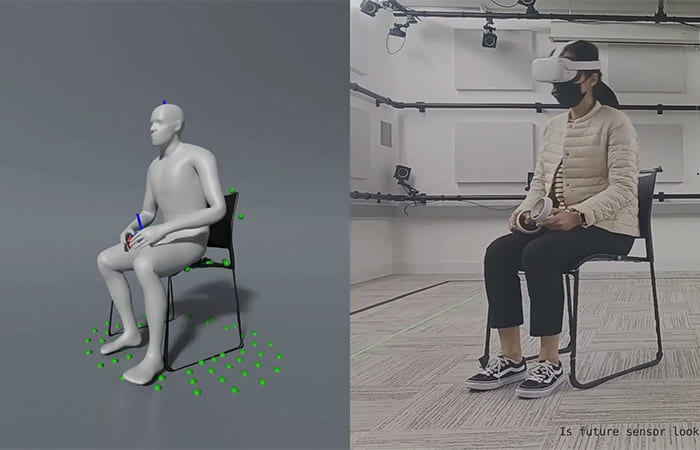

메타 연구진이 가구에 앉은 이용자가 어떤 자세를 하고 있는지 추정하는 AI 연구 결과를 업데이트했습니다.

지난 해 3명의 메타 연구원은 퀘스트2의 컨트롤러와 추적 데이터 만으로 서 있는 자세를 그럴 듯하게 추정하도록 강화된 기계 학습인 퀘스트심(QuestSim)을 선보인바 있습니다.

하지만 당시 퀘스트심은 의자나 소파에 앉아 상호 작용하는 이용자의 자세를 추적하는 데 실패했고, 세 연구원은 이 연구를 지속했습니다.

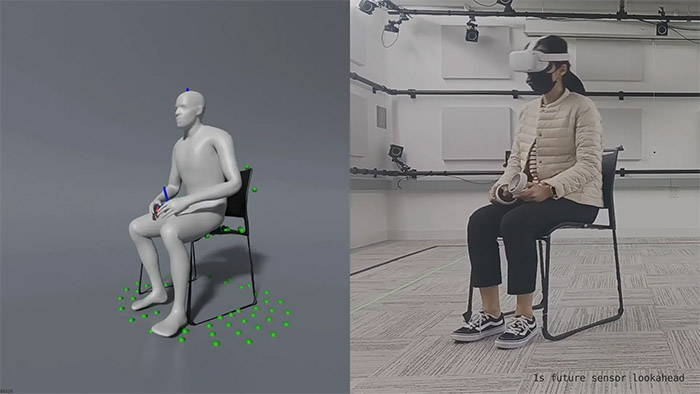

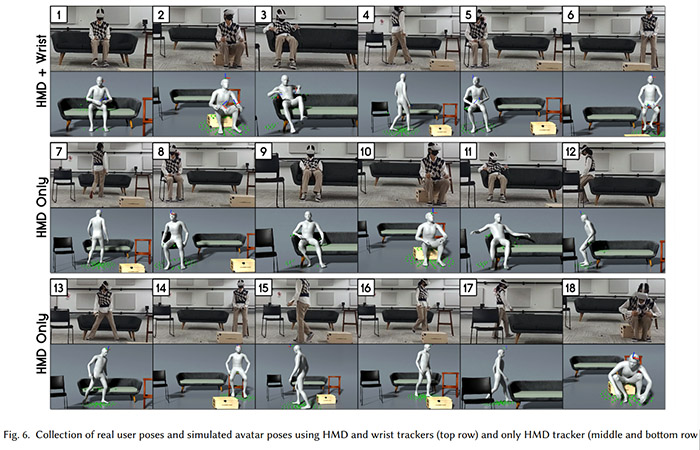

세 연구원은 이전과 동일한 강화 학습 접근 방식을 사용해 가구 및 기타 물체를 고려하는 업데이트된 모델인 퀘스트엔비심(QuestEnvSim)을 새 논문에서 발표했습니다.

이 연구의 결과로 퀘스트2 헤드셋과 컨트롤러를 들고 의자에 앉은 착용자의 실제 모습과 매우 유사하게 앉은 자세를 표현하는 데 성공했습니다.

하지만 이 논문에는 이를 실행하는 데 필요한 런타임 성능을 설명하지 않았고, 의자를 수작업으로 스캔해 배치한 데다, 정확한 자세를 표현하지는 못하는 것으로 확인됐습니다.

그래도 현재 이러한 실험들을 통해 얻은 결과를 토대로 장기간 고도화 작업을 거치면 언젠가 헤드셋과 컨트롤러만 있어도 제대로 행동하는 전신 아바타를 볼 수 있게 될 것 같군요.