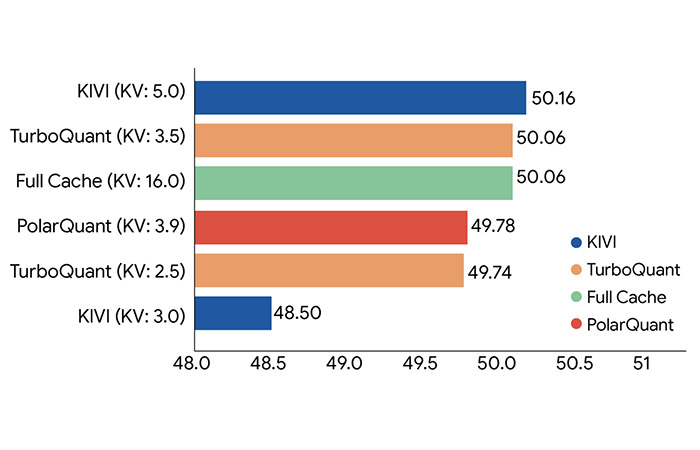

구글 리서치가 대규모 언어 모델(LLM)의 추론 효율을 획기적으로 높여주는 새로운 압축 알고리듬인 ‘터보퀀트(TurboQuant)’를 공개했습니다.

터보퀀트는 AI 모델을 구동할 때 맥락 이해를 위해 메모리를 대량으로 점유하는 핵심 요소인 ‘KV 캐시’를 정밀하게 압축해 시스템 병목 현상을 해결합니다.

특히 데이터를 3비트 수준으로 압축하면서도 인공지능의 답변 정확도 저하를 거의 발생시키지 않는다는 점이 이번 기술의 핵심입니다.

터보퀀트는 기존 표준 방식인 FP16 대비 메모리 소비를 최대 6배까지 줄였고, 데이터 처리 속도는 최대 8배까지 향상시키는 성과를 거두었습니다.

이를 통해 엔비디아 H100 GPU 한 대에서 최대 100만 토큰에 이르는 방대한 문맥 데이터를 안정적으로 처리할 수 있게 되었고, 상대적으로 적은 램을 가진 그래픽 카드들도 성능 향상을 기대할 수 있습니다.

터보퀀트는 메모리 한계로 인해 불가능했던 작업을 처리하면서도 운영 비용 및 에너지 소모를 줄일 것으로 기대를 모으고 있지만, 소규모 언어 모델이나 이미지 및 음악 생성에선 효과가 없을 것으로 예상됩니다.